توسط محققان ایرانی دانشگاه پنسیلوانیا انجام شد

محققان ایرانی دانشگاه پنسیلوانیا به تازگی یک تراشه نوری قدرتمند جدید ساختهاند که میتواند تقریباً دو میلیارد تصویر را در هر ثانیه پردازش کند.

به گزارش خبرگزاری دانا و به نقل از تکاکسپلور، هوش مصنوعی(AI) نقش مهمی در بسیاری از سیستمها، از پیشبینی کننده متن در تلفنهای هوشمند تا تشخیصهای پزشکی ایفا میکند. بسیاری از سیستمهای هوش مصنوعی با الهام از مغز انسان براساس شبکههای عصبی مصنوعی ساخته میشوند. شبکه عصبی مصنوعی معادلهای الکتریکی نورونهای بیولوژیکی هستند که به هم متصل میشوند و با مجموعهای از دادههای شناخته شده مانند تصاویر آموزش داده میشوند و سپس برای شناسایی یا طبقهبندی دادههای جدید مورد استفاده قرار میگیرند.

به گزارش خبرگزاری دانا و به نقل از تکاکسپلور، هوش مصنوعی(AI) نقش مهمی در بسیاری از سیستمها، از پیشبینی کننده متن در تلفنهای هوشمند تا تشخیصهای پزشکی ایفا میکند. بسیاری از سیستمهای هوش مصنوعی با الهام از مغز انسان براساس شبکههای عصبی مصنوعی ساخته میشوند. شبکه عصبی مصنوعی معادلهای الکتریکی نورونهای بیولوژیکی هستند که به هم متصل میشوند و با مجموعهای از دادههای شناخته شده مانند تصاویر آموزش داده میشوند و سپس برای شناسایی یا طبقهبندی دادههای جدید مورد استفاده قرار میگیرند.در شبکههای عصبی سنتی که برای تشخیص تصویر استفاده میشوند، تصویر شی مورد نظر ابتدا بر روی یک حسگر تصویر، مانند دوربین دیجیتال تلفن هوشمند، شکل میگیرد. سپس، حسگر تصویر، نور را به سیگنالهای الکتریکی و در نهایت به دادههای باینری تبدیل میکند که میتواند با استفاده از تراشههای کامپیوتری پردازش، تجزیه و تحلیل، ذخیره و طبقهبندی شود. سرعت بخشیدن به این تواناییها برای بهبود تعداد زیادی از کاربردها، مانند تشخیص چهره، تشخیص خودکار متن در عکسها، یا کمک به ماشینهای خودران در تشخیص موانع، ضروری است.

در حالی که یک تراشه با فناوری طبقهبندی تصاویر در سطح فعلی میتواند میلیاردها محاسبات در ثانیه انجام دهد و برای اکثر کاربردها به اندازه کافی سریع است اما طبقهبندی تصاویر پیچیدهتر مانند شناسایی اجسام متحرک، شناسایی اشیاء سهبعدی یا طبقهبندی سلولهای میکروسکوپی در بدن، توانایی و محدودیتهای محاسباتی قویترین فناوریها را حتی تحت فشار قرار میدهد.

برای رفع این محدودیت، مهندسان دانشگاه پنسیلوانیا اولین تراشه مقیاسپذیر را ایجاد کردهاند که تصاویر را تقریباً بلافاصله طبقهبندی و شناسایی میکند. "فیروز افلاطونی"، دانشیار مهندسی برق و سیستمها، به همراه "فرشید آشتیانی"، دانشجوی فوقدکتری و "الکساندر جیرز"(Alexander J. Geers)، دانشجوی کارشناسی ارشد، چهار علل اصلی زمانبر شدن محاسبات در تراشههای رایانهای سنتی را حذف کردند. این موارد شامل تبدیل سیگنالهای نوری به الکتریکی، نیاز به تبدیل دادههای ورودی به فرمت باینری، یک ماژول حافظه بزرگ و محاسبات مبتنی بر زمان بود.

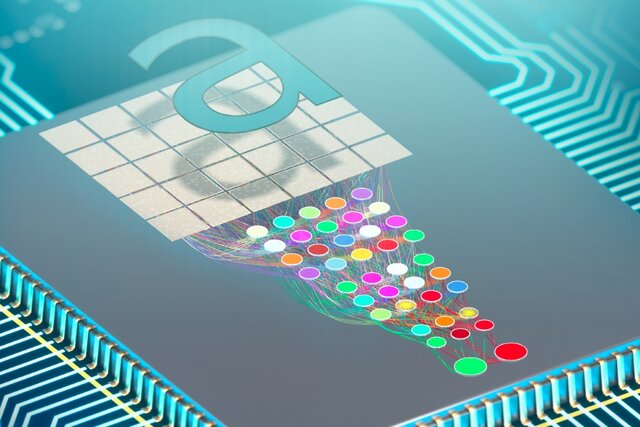

آنها از طریق پردازش مستقیم نور دریافتی از شی با استفاده از یک شبکه عصبی عمیق نوری که بر روی یک تراشه ۹.۳ میلیمتر مربعی پیادهسازی شده است به این امر دست یافتند.

این مطالعه که در مجله "نیچر"(Nature) منتشر شده است، توضیح میدهد که چگونه بسیاری از سلولهای عصبی نوری تراشه با استفاده از سیمهای نوری یا "موجبرها"(waveguides) به هم متصل میشوند تا شبکهای عمیق از بسیاری از "لایههای عصبی"(neuron layers) که شبیه به مغز انسان هستند را تشکیل دهند. اطلاعات از لایههای شبکه عبور میکند و هر مرحله به طبقهبندی تصویر ورودی در یکی از دستههای آموخته شده کمک میکند. در مطالعه محققان، تصاویری که تراشه طبقهبندی کرد، تصویری از کاراکترهای رسم شده به صورت دستی و حروف مانند بود.

درست مانند شبکه عصبی در مغز ما، این شبکه عمیق به گونهای طراحی شده که امکان پردازش سریع اطلاعات را فراهم میکند. محققان نشان دادند که تراشه آنها میتواند در نصف نانوثانیه، یک طبقهبندی کامل تصویر را به انجام برساند. این میزان معادل زمانی است که تراشههای رایانهای دیجیتال سنتی در آن یک مرحله محاسباتی خود را به انجام میرسانند.

"افلاطونی" میگوید: تراشه ما اطلاعات را از طریق آنچه ما "محاسبه به واسطه انتشار "(computation-by-propagation) مینامیم پردازش میکند، به این معنی که بر خلاف سیستمهای مبتنی بر زمان، محاسبات با انتشار نور از طریق تراشه انجام میشود. ما همچنین از مرحله تبدیل سیگنالهای نوری به سیگنالهای الکتریکی صرفنظر میکنیم، زیرا تراشه ما میتواند سیگنالهای نوری را مستقیماً بخواند و پردازش کند، و هر دوی این تغییرات، تراشه ما را به فناوری بسیار سریعتری تبدیل میکند.

توانایی این تراشه برای پردازش سیگنالهای نوری به طور مستقیم بر مزایای آن میافزاید.

"آشتیانی" میگوید: وقتی تراشههای رایانهای فعلی سیگنالهای الکتریکی را پردازش میکنند، اغلب آنها را از طریق یک واحد پردازش گرافیکی یا GPU اجرا میکنند که فضا و انرژی اشغال میکند. تراشه ما نیازی به ذخیره اطلاعات نداشته و نیاز به داشتن یک واحد حافظه بزرگ را از بین میبرد.

"افلاطونی" میگوید: با حذف واحد حافظهای که تصاویر را ذخیره میکند، امنیت دادهها را نیز افزایش میدهیم. با تراشههایی که مستقیماً دادههای تصویر را میخوانند، نیازی به ذخیرهسازی عکس نیست و در نتیجه نشت دادهها رخ نمیدهد.

تراشهای که اطلاعات را با سرعت نور میخواند و درجات بالاتری از امنیت سایبری را فراهم میکند، بدون شک در بسیاری از زمینهها کاربرد خواهد داشت. این یکی از دلایلی است که تحقیقات در مورد این فناوری در چند سال گذشته افزایش یافته است.

"گیرز" میگوید: ما اولین کسانی نیستیم که فناوری ارائه کردیم که سیگنالهای نوری را مستقیماً میخواند، اما اولین کسانی هستیم که یک سیستم کامل را در یک تراشه ایجاد میکنیم که هم با فناوریهای موجود سازگار است و هم برای کار با دادههای پیچیدهتر مقیاسپذیر است.

این تراشه، با طراحی شبکه عمیق خود، نیاز به آموزش برای یادگیری و طبقهبندی مجموعه دادههای جدید، مشابه نحوه یادگیری انسان دارد. هنگامی که یک مجموعه داده معین ارائه میشود، شبکه عمیق اطلاعات را دریافت میکند و آنها را در دستههایی که پیشتر آموخته، طبقهبندی میکند.

مهندسان میتوانند با افزودن لایههای عصبی بیشتر مقیاس آن را افزایش دهند و به تراشه امکان بررسی تصاویر پیچیدهتر با وضوح بالاتر را بدهند.

"افلاطونی" میگوید: آن چه که واقعاً در مورد این فناوری جالب است این است که میتواند کاری بسیار بیشتر از طبقهبندی تصاویر انجام دهد. ما میدانیم که چگونه انواع دادهها را به دامنه الکتریکی تبدیل کنیم. تصاویر، صدا، گفتار و بسیاری از انواع دادههای دیگر. اکنون، میتوانیم انواع دادههای مختلف را به دامنه نوری تبدیل کنیم که تقریباً بلافاصله با استفاده از این فناوری پردازش میشوند.

او ادامه میدهد: برای درک اینکه این تراشه با چه سرعتی میتواند اطلاعات را پردازش کند، یک نرخ فریم(frame rate) معمولی فیلمها را تصور کنید. یک فیلم با سرعت بین ۲۴ تا ۱۲۰ فریم در ثانیه پخش میشود. در حالی که این تراشه میتواند نزدیک به دو میلیارد فریم در ثانیه را پردازش کند! ما اکنون برای مواردی که نیاز به محاسبات بسیار سریع دارند، راه حلی داریم و بسیاری از کاربردهای آن ممکن است در این لحظه قابل درک نباشند.

انتهای پیام